El aislamiento social empuja a los humanos a mantener las comunicaciones con amigos y familiares de forma remota. Esto podría propiciar que la inteligencia artificial desempeñe un papel que permita mantener nuestras conversaciones encaminadas, según la Universidad de Cornell.

Un nuevo estudio titulado “IA como una zona de amortiguación moral: los efectos de la IA mediadora de comunicación sobre la atribución y confianza”, publicado en línea en la revista Computers in Human Behavior, reveló que las personas que tenían conversaciones difíciles confiaban en sistemas de inteligencia artificial para que les sugirieran respuestas “inteligentes” para escribir, más que en la persona con la que estaban hablando.

“Descubrimos que cuando las cosas salen mal, las personas asumen la responsabilidad que de otro modo habría sido designada a su compañero humano y designan algo de eso al sistema de inteligencia artificial”, dijo Jess Hohenstein, un estudiante de doctorado en el campo de la ciencia de la información y el primer autor del artículo. “Esto introduce un potencial para tomar la IA y usarla como mediador en nuestras conversaciones”.

Hohenstein cree que la IA podría actuar como una mediadora de conflicto entre dos o más personas, sugiriendo estrategias de resolución de conflicto. Lo que este estudio buscó evaluar es la manera en que las respuestas inteligentes de sistemas de IA están afectando la manera como las personas interactúan.

Las personas deciden elegir estas respuestas sugeridas, pues aunque puede que no sean exactas a lo que estaban pensando, ahorran tiempo de tipeo de palabras, pero esto podría alternar sus conversaciones y sus relaciones.

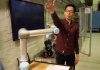

“La comunicación es tan fundamental para formar percepciones de los demás, cómo formamos y mantenemos relaciones, o cómo podemos lograr algo trabajando juntos”, dijo el coautor Malte Jung, profesor asistente de ciencias de la información y director de Robots en el laboratorio de Grupos, que explora cómo los robots alteran la dinámica del grupo.

“Este estudio se encuentra dentro de la agenda más amplia de comprender cómo estos nuevos sistemas de IA interfieren con nuestra capacidad de interactuar”, dijo Jung. “A menudo pensamos en cómo el diseño de los sistemas afecta la forma en que interactuamos con ellos, pero menos estudios se centran en la cuestión de cómo las tecnologías que desarrollamos afectan la forma en que las personas interactúan entre sí”.

Es así como este estudio no solo tiene la intención de dejar en claro cómo las personas usan las respuestas inteligentes, sino también cómo estas afectan la comunicación humana. Hohenstein y Jung dijeron que buscaron explorar si la IA podría funcionar como una “zona de amortiguación moral”, diseñada tal y como funcionan los amortiguadores de vehículos, para absorber el impacto (peleas, disputas, etc.). Encontraron que, en efecto, la IA podría absorber parte de la responsabilidad moral en una discusión al ser intermediaria.